Los auriculares para vídeo son el futuro de la tecnología

Steve Jobs ya lo pronosticó en 2007 y hay patentes al respecto.

Las reviews, ya más reposadas, del Vision Pro han comenzado ha llegar. También lo ha hecho el unboxing con la producción más épica ever. Pero por fin hemos comprendido que el nuevo casco, perdón por banalizar así su nombre, de Apple, es entre otras cosas unos auriculares para video. Os prometo que con esto me ha explotado la cabeza, porque es verdad.

Los primeros auriculares tenían no tenía gran calidad de sonido, en cambio, tenía un cable que se enredaba con absolutamente todo lo que se le ponía a tiro y eran demasiado grandes e incómodos. Hasta que llegaron los AirPods. De repente pasamos a tener un dispositivo que nos permitía escuchar, y a la vez interactuar mediante la voz, de una forma en la que el dispositivo pasaba totalmente inadvertido para el que lo llevaba puesto. Y eso es será el Vision Pro al vídeo.

Además, podrás ver e interactuar con pantallas de información y con el propio entorno físico, mediante un dispositivo que no tengas que sostener en la mano, y cuya pantalla es prácticamente infinita. ¿Smarphone? ¡A dónde vamos no necesitamos … smartphone!

Si quereis saber más sobre Vision Pro basada en la experiencia que hemos tenido y descubrir el lado “más espiritual” de Julio César Fernández, os invitamos a ver (que no escuchar) su último Apple Coding Daily en nuestro canal de Youtube. Porque ahí os contará todo lo que es y no es Vision Pro a día de hoy, pero lo hará en Persona. Podéis verlo aquí mismo.

Rumores y avisos a navegantes

Enlazando con las Vision Pro, el sistema que lo gobierna, visionOS, ha supuesto todo un reto a la hora del diseño de interfaces. El juego de transparencias para hacer que las ventanas se integren con el fondo (ya sea real o virtual) mediante distintas capas, es una obra digna de los mejores orfebres de Cupertino. En 9to5mac se hacían eco esta semana, de un posible rediseño para las futuras versiones de los demás sistemas operativos de Apple. Quizás sea el momento de la unificación total, porque visionOS tiene un poco de experiencia de escritorio y también de tablet. A lo mejor los de la manzana han encontrado el anillo único para unirlos a todos.

Como no podía ser menos, para Apple, la privacidad es fundamental y podemos descubrir cómo un dispositivo, que por sus cámaras y sensores podría parecer que es una herramienta de espionaje en sí mismo, sin embargo, tiene un buen número de medidas para proteger nuestra privacidad, incluso de los desarrolladores poco éticos que quisieran sacar provecho del mismo. Tenéis un extenso informe en un PDF para leerlo publicado por la propia Apple en este enlace.

Siguiendo con las noticias, Apple ha publicado la fecha en la que las aplicaciones que se suban al App Store, deben utilizar las últimas tecnologías liberadas el pasado otoño. A saber: Xcode 15 para iOS 17, iPadOS 17, tvOS 17, y watchOS 10. Y el día elegido es el 29 de Abril. A partir de esa fecha, cualquier actualización o nueva aplicación que no se haya construido con esas versiones de Xcode y de los SDK, será rechazada automáticamente.

Novedades: Un poquito de ML y otro poquito de Swift

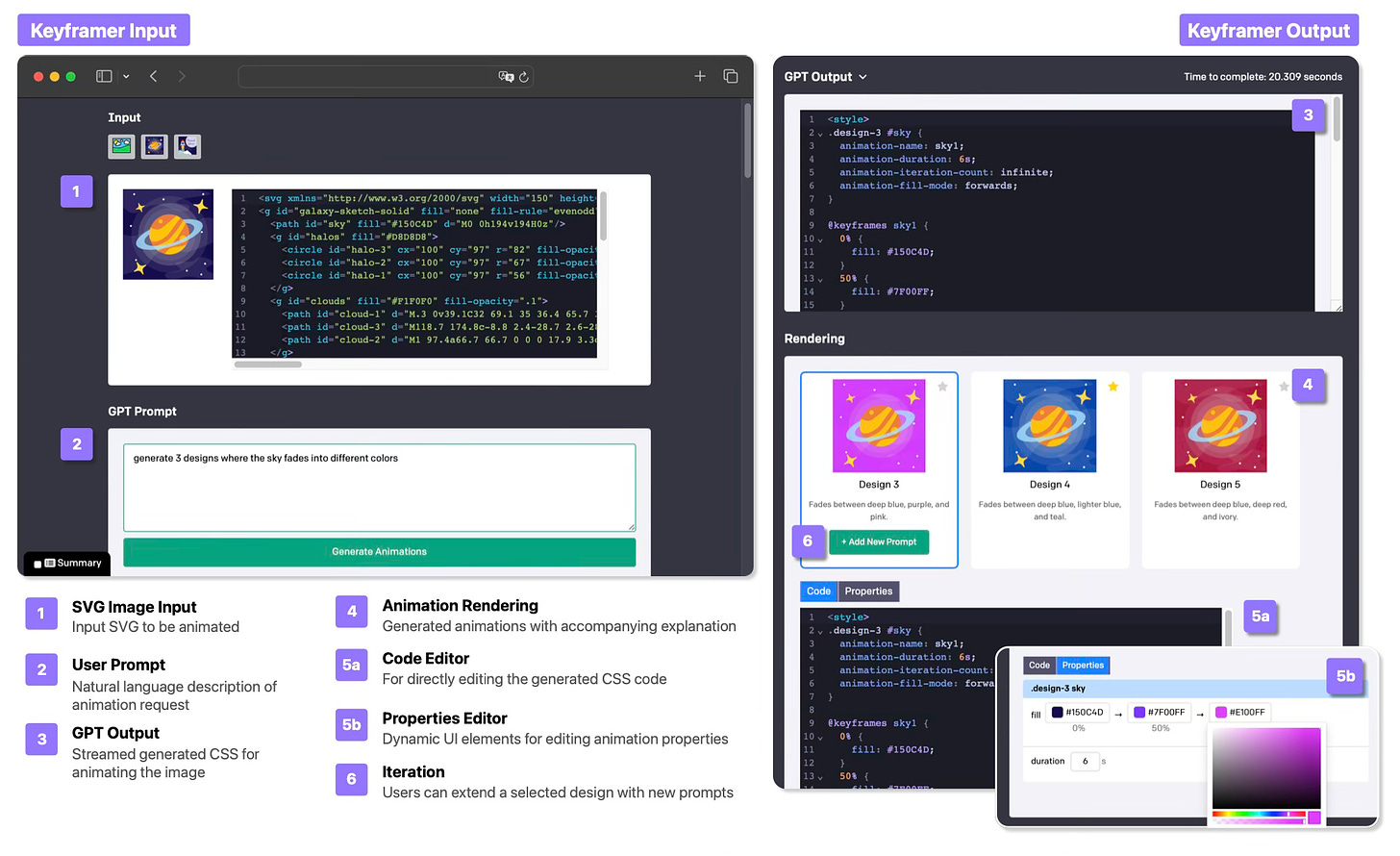

De todos es sabido que la investigación y el desarrollo de modelos de lenguaje para Machine Learning viene muy ligado al mundo científico. En el gremio, la reputación de los investigadores está basada en el número de publicaciones científicas en las que participan. Aunque otra forma de dar a conocer el trabajo es hacer públicos los modelos generados y los papers de investigación. Si Apple ya jugaba a este juego desde hace años, ahora ha entrado de lleno con lanzamientos casi semanales. Esta vez con el modelo MGIE, que permite la edición de imágenes utilizando comandos de texto mediante lenguaje natural. Y también Keyframer, un modelo que permite animar gráficos vectoriales SVG mediante modelos de lenguaje.

El hype de cara a la WWDC está servido. Si queréis estar al día de todo lo que Apple presenta en el campo de la IA generativa, no dejéis de vigilar la web de Machine Learning de la compañía en machinelearning.apple.com.

Otra novedad pequeña, pero no por ello menos importante, es la liberación de la versión 1.1.0 del paquete Swift Collections. Desde sus primeras iteraciones, fue concebido para facilitar el trabajo con estructuras de datos y en esta última release, además de nuevas estructuras, ha añadido funciones para el filtrado y la ordenación. ¿Lo has utilizado? ¡Te leemos!

Offtopic: Otro corte de mangas a la Unión Europea

Por si no fuese poco el troleo de Apple a la UE con los cambios para cumplir con la Ley de Mercados Digitales, WhatsApp también lo ha hecho de forma ostensible. Otras aplicaciones, como la propia iMessage de Apple, han optado por adoptar el servicio RCS como forma de interoperabilidad. Pero la subsidiaria de Meta ha anunciado que implementará una suerte de API para integrarse con sus sistema de forma que se siga respetando el cifrado extremo a extremo del protocolo Signal.

Esto que a priori parece un movimiento en pos de los usuarios, está muy lejos de serlo. Me explico. Implementando una plataforma de terceros, como RCS, WhatsApp sólo vería el tráfico que sus usuarios lanzan hacia ese servicio cuando se comunique, siguiendo con el ejemplo, con iMessage. Pero si utilizan una API, y por tanto una plataforma propia, los de Meta tendrían acceso a los metadatos completos de todas la conversaciones. Una jugada maestra por su parte, sin duda alguna.

Aunque ojo al dato, Apple ha conseguido convencer a la UE que el uso de iMessage en Europa es tan residual, que finalmente no tendrá que implementar otras apps en conversaciones de terceros como sí tendrá que hacer WhatsApp. Así que la integración de RCS, estará, pero seguirá permitiendo que iMessage funcione como hasta ahora.

Observando los any

Lo sé, he ido a lo fácil. Y hablando de fácil (lo he vuelto a hacer…), iOS 17 con el nuevo patrón Observable, ha simplificado la sintaxis para obtener reactivadad en SwiftUI. Pero lo realmente importante está bajó el capó, porque la mejora de rendimiento es muy grande. Esta pieza de Donny Wals nos muestra cómo hacer saltar desde el vetusto ObservableObject, y algunas consideraciones como que ya no es necesario el framework Combine.

Si has llegado hasta aquí ahora viene el lío. El artículo cafetero es obra del compañero Antoine van der Lee y trata sobre todos los any que implementa el lenguaje Swift. El trío calavera AnyObject, Any y any al desnudo para rematar una edición más de nuestra newsletter.

Y poco más

Se acercan las versiones .4 de primavera, este año movidas por la irrupción de la Ley de Mercados Digitales y el Vision Pro, así que no hay tregua. Si lo que lees te gusta o piensas que podemos mejorar algo puedes contactarnos en caffeswift@gmail.com o a través de nuestra cuenta en X como @caffeswift.

Nos leemos pronto, si Jobs quiere, y hasta entonces: un saludo y Good Apple Coding.

Muchas gracias por este newsletter, es muy interesante y esperando el nuevo caffe Swift para poder oir mas novedades, ya sabemos que con el Boot Camp y todo. ahora debes estar mas justo de tiempo, pero ahí tienes unos fieles seguidores a los cuales les gusta vuestras conversaciones que aunque largas se nos hacen muy cortas!!!

Muchas gracias por lo que aportáis ambos a este mundo que en español ahí pocos que lo hagan y menos aun con vuestra calidad.